En la reciente GTC, Jensen Huang dejó en claro que ya no estamos hablando simplemente de modelos generativos, sino de sistemas multi-agente (Agentic AI) y centros de datos a escala de gigavatios, o como él los llama, “Fábricas de IA”.

Para lograr esto, NVIDIA presentó la plataforma Vera Rubin, y como analista, te digo que lo más disruptivo no es la fuerza bruta del nuevo silicio, sino cómo están resolviendo el cuello de botella de la latencia en la inferencia integrando la tecnología de Groq. Vamos a desarmar técnicamente qué significa todo esto para el futuro del hardware.

El ecosistema Vera Rubin y el monstruoso Rack NVL72

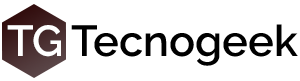

NVIDIA decidió volver a su nomenclatura basada en la cantidad de paquetes de GPU. El nuevo rack Vera Rubin NVL72 es una bestia que integra siete chips completamente nuevos trabajando en tándem:

- CPUs Vera

- GPUs Rubin

- Switches NVLink 6 (para escalabilidad interna)

- NICs ConnectX-9 y Spectrum-X (con óptica co-empaquetada para escalabilidad externa)

- DPUs BlueField 4

- LPUs Groq 3 (la gran sorpresa)

A nivel de rendimiento, NVIDIA afirma que este ecosistema ofrece una mejora de un orden de magnitud en rendimiento por vatio en comparación con Grace Blackwell. Para ponerlo en perspectiva: si estás entrenando modelos masivos de Mezcla de Expertos (MoE), el NVL72 puede hacerlo en el mismo tiempo usando una cuarta parte de las GPUs que necesitabas con la generación anterior. Esta eficiencia térmica y de cómputo es vital cuando hablamos de instalaciones a escala de gigavatios.

Groq 3 LPU: El triunfo de la SRAM sobre la HBM en inferencia

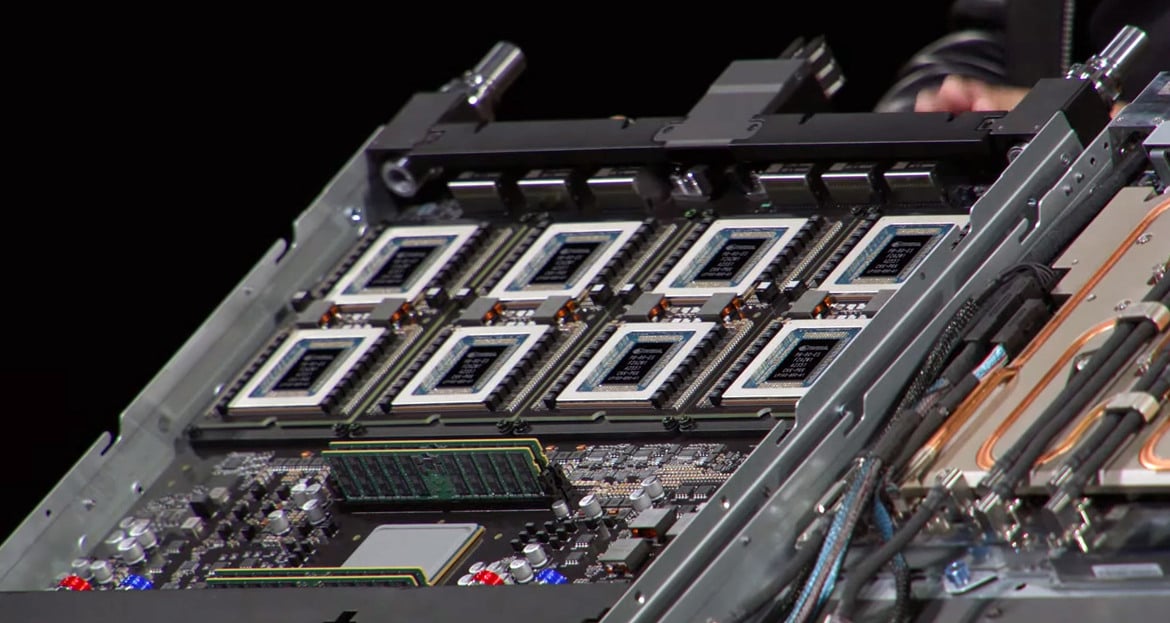

Acá es donde la arquitectura se pone realmente interesante. NVIDIA capitalizó la propiedad intelectual que adquirió de Groq el año pasado para introducir el Groq 3 LPU (Language Processing Unit). Si mirás la capacidad de cómputo puro, el Groq 3 parece modesto: tiene solo una veinticincoava parte (1/25) del rendimiento de una GPU Rubin. Pero su secreto está en la jerarquía de memoria.

A diferencia de las GPUs tradicionales que dependen de la memoria HBM (High Bandwidth Memory), cada chip Groq 3 LPU integra 500 MB de memoria SRAM. Sí, la misma memoria ultrarrápida que usamos para las cachés L1/L2/L3 en CPUs y GPUs. Mientras que una GPU Rubin cuenta con unos masivos 288 GB de HBM4 que entregan 22 TB/s de ancho de banda, los modestos 500 MB de SRAM del Groq 3 logran unos absurdos 150 TB/s de ancho de banda.

¿Por qué esto es revolucionario? Porque en la inferencia de IA (específicamente en la fase de decodificación y generación de tokens), el cuello de botella no es el cómputo matemático, sino el ancho de banda de la memoria. La SRAM permite una latencia ultrabaja, ideal para sistemas agénticos que requieren alta interactividad.

El Rack Groq 3 LPX: Aceleración a nivel de token

NVIDIA no te va a vender estos chips sueltos. Los empaquetó en el Rack Groq 3 LPX, que contiene 256 chips LPU. Fijate en estos números por rack:

- 128 GB de SRAM total

- 40 PB/s (Petabytes por segundo) de ancho de banda

- Interfaz de escalabilidad dedicada de 640 TB/s

Ian Buck, VP de Hyperscale de NVIDIA, posiciona al Groq LPX como un co-procesador para Rubin. Al combinar el NVL72 con el LPX, el sistema puede entregar hasta 35 veces más “tokens por segundo por megavatio” en comparación con Blackwell. Esto está diseñado específicamente para la próxima frontera: modelos de billones de parámetros con ventanas de contexto de millones de tokens, donde múltiples agentes de IA dialogan entre sí en tiempo real.

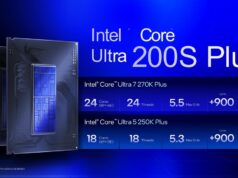

CPU Vera: NVIDIA le marca la cancha al x86-64

No podemos dejar de lado el lanzamiento de la CPU Vera. NVIDIA la describe como el primer procesador construido específicamente para el aprendizaje por refuerzo (Reinforcement Learning) y la IA de agentes. Cuenta con 88 núcleos personalizados “Olympus” diseñados por la propia NVIDIA.

El dato duro acá es que NVIDIA asegura que Vera es un 50% más rápida y tiene el doble de eficiencia que las CPUs tradicionales de escala de rack (apuntando directamente a la arquitectura x86-64 de Intel y AMD). Para soportar esto, presentaron una configuración de rack exclusivo de CPUs Vera que integra 256 procesadores refrigerados por líquido.

Lo que estamos viendo con la plataforma Vera Rubin es un cambio de paradigma en el diseño de hardware para IA. NVIDIA se dio cuenta de que usar GPUs monolíticas masivas para todo el pipeline de IA es ineficiente. El entrenamiento requiere cómputo masivo y mucha capacidad de memoria (territorio de la GPU Rubin y HBM4), pero la inferencia interactiva requiere mover datos a velocidades ridículas con latencia casi nula (territorio del LPU Groq 3 y SRAM).

Al integrar la arquitectura de Groq, NVIDIA está creando un clúster heterogéneo donde cada chip hace lo que mejor sabe hacer. Es una respuesta directa a la limitación física de la memoria HBM y un movimiento maestro para dominar la era de la “Agentic AI”, donde el tiempo de respuesta entre máquinas será el nuevo estándar de oro de la industria.

Fuentes de referencia: