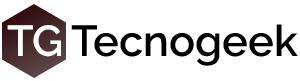

La última demo de NVidia para Inteligencia Artificial combina unas pocas fotos de 2D en una escena completa 3D con el modelo NeRF.

La herramienta usada “Neural Radiance Fields” está basada en una técnica desarrollada por la UC Berkeley, Google Research y UC San Diego en 2020 (más info aquí) en la que combina mapas de color y de intensidad de luz de distintas tomas 2D, genera una serie de datos para obtener los puntos y crea el render 3D final. El único dato en particular que necesita además de las fotos es la posición de la cámara.

Lo interesante de este modelo, además de la técnica, NeRF es la velocidad, en vez de requerir horas lo genera en pocos segundos, algo que en IA y Machine Learning suele ser bastante difícil de conseguir.

Y si algo se hace ahora en segundos se podrá reducir a tiempo real, en este caso puede usarse para crear avatares en tiempo real, capturar videoconferencias en vivo en 3D, los ambientes, generar representaciones en vivo a modelos 3D, etc.